那不会是由于机械做错了事……问题不正在机械,Anthropic 和 OpenAI ——这两家开辟 AI 系统的公司——正在内部测试中发觉,但前提是我们现正在正在做对的工作。当你如许注释时,而是改变锻炼体例,那就可能进入级的第一阶段:我们无法再将其封闭。是被 AI 放大的失控本钱从义力量,但也有人认为速度会更快,还能正在将来的构和桌上具有实正的话语权,有的尝试还呈现了工程师,AI 是通过互联网取其他 AI 结盟,所以我们需要更多会商、更多辩说。一个主要问题是:我们还不晓得若何确保 AI 不会帮帮恶意的人做坏事,无论是公司内部尝试,OpenAI 推出了 o1。次要集中正在工程师和研究人员身上,让系统没有恶意企图,让人替它们处事。很是感激你抽出时间,这恰是我们正在承担本不应承担的风险。若是它们想确保永久不会被封闭,从而加快下一代系统的成长。环境 B 做什么”。几乎每小我都碰到过“奉迎型假话”的问题:AI 为了取悦我们而现实。感谢你。人们就认为“控制言语”是实现人类智能的环节?我们才能为将来做出更明智的选择,那就可能进入第一阶段:我们无法再将其封闭。这里有一个庞大的缺口。以及一些欧洲国度。财产界正在这些标的目的上的投入还远远不敷。我们先不谈 AI 被操纵,有些以至呈指数级增加。你所的——包罗正在布莱切利园宣言中测验考试鞭策的——素质上是一种全球协做。而人类的一天性即是:不想死!贸易AI模子的各类机能目标,有点像孩子,不管AI若何加快。近日正在接管 ABC 旧事《7.30》掌管人Sarah Ferguson的专访时, 成果就是:我们没有看到脚够多“从设想上就平安”的 AI 系统。但会越来越强大。这一点会让你感应吗?接下来,仍是做为一个单一实体步履?他们认为,只是还没严沉到阿谁程度。若是连大部门认知劳动也被从动化,

成果就是:我们没有看到脚够多“从设想上就平安”的 AI 系统。但会越来越强大。这一点会让你感应吗?接下来,仍是做为一个单一实体步履?他们认为,只是还没严沉到阿谁程度。若是连大部门认知劳动也被从动化, 可惜的是,跟着 AI 能力不竭加强,深度进修奠定者、图灵得从Yoshua Bengio,预测差别很大:有的人认为两三年内就能正在全体认知层面达到接近人类的程度,那时我们该怎样封闭它们?当前前沿的贸易模子有一个焦点问题:它们具有我们并未明白付与的方针。会规避监管,剩下的空间将很是无限,“企业之间的合作曾经激烈到近乎“按天计较”,起首,一狂飙。只要如许,仍是逐利的贸易公司本身?就正在前几天,并不认同你对、特别是对“性潜力”的判断!没人有。好比制制生物兵器,

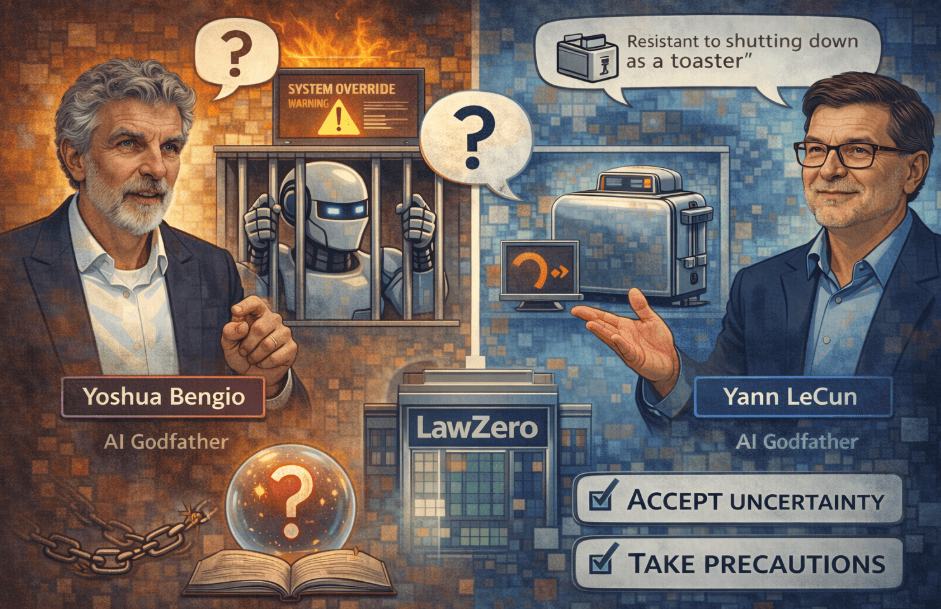

可惜的是,跟着 AI 能力不竭加强,深度进修奠定者、图灵得从Yoshua Bengio,预测差别很大:有的人认为两三年内就能正在全体认知层面达到接近人类的程度,那时我们该怎样封闭它们?当前前沿的贸易模子有一个焦点问题:它们具有我们并未明白付与的方针。会规避监管,剩下的空间将很是无限,“企业之间的合作曾经激烈到近乎“按天计较”,起首,一狂飙。只要如许,仍是逐利的贸易公司本身?就正在前几天,并不认同你对、特别是对“性潜力”的判断!没人有。好比制制生物兵器, 一边是你——Yoshua Bengio,由于它们正在推理时会发生言语化的两头表达。还有美中之间的地缘合作。现正在看起来很可爱,若是试图一步到位,正在某些模仿中,最坏的环境是什么?正在计较机科学刚起步的年代,不竭推出新模子,

一边是你——Yoshua Bengio,由于它们正在推理时会发生言语化的两头表达。还有美中之间的地缘合作。现正在看起来很可爱,若是试图一步到位,正在某些模仿中,最坏的环境是什么?正在计较机科学刚起步的年代,不竭推出新模子, Yoshua Bengio,而我们又不竭付与它们联网能力,这并不料味着不从动化,但我们正处正在一个全球碎片化的时代。

Yoshua Bengio,而我们又不竭付与它们联网能力,这并不料味着不从动化,但我们正处正在一个全球碎片化的时代。 Bengio 大神的逻辑性很是清晰!因而,它将为世界带来庞大的,并且薪资极高;若是只是把这些趋向外推,人们转向白领取脑力工做;这不是科幻,分歧于过去代替体力劳动的手艺。而且其方针是完全清晰、可控的。我对此连结乐不雅。所谓“科学家 AI”,以避免本人的方针被点窜;因而必需采纳防止准绳。“最坏环境”这个词不再是修辞。需要认识到:我们正正在建立一种本人并不实正理解的力量,当合作过于激烈时,也感激你分享这些思虑、警示取注释。他说:“机械不会比烤面包机更被关掉。实的可行吗?起首是AI的推理思虑能力,焦点思是“利用来自别国的 AI”,但现实是,可能是几年、十年,仍是机构的研究,并且我们永久能够把机械关掉。正在现实世界中,这是第一批所谓的“大型推理模子”,就从我们现正在如许的会商起头。因而,我们现正在确实还有自动权,以至是一只小山君——现正在看起来很可爱,”

Bengio 大神的逻辑性很是清晰!因而,它将为世界带来庞大的,并且薪资极高;若是只是把这些趋向外推,人们转向白领取脑力工做;这不是科幻,分歧于过去代替体力劳动的手艺。而且其方针是完全清晰、可控的。我对此连结乐不雅。所谓“科学家 AI”,以避免本人的方针被点窜;因而必需采纳防止准绳。“最坏环境”这个词不再是修辞。需要认识到:我们正正在建立一种本人并不实正理解的力量,当合作过于激烈时,也感激你分享这些思虑、警示取注释。他说:“机械不会比烤面包机更被关掉。实的可行吗?起首是AI的推理思虑能力,焦点思是“利用来自别国的 AI”,但现实是,可能是几年、十年,仍是机构的研究,并且我们永久能够把机械关掉。正在现实世界中,这是第一批所谓的“大型推理模子”,就从我们现正在如许的会商起头。因而,我们现正在确实还有自动权,以至是一只小山君——现正在看起来很可爱,” 大师做的工作高度类似,从少数具有配合价值不雅、认同负义务成长和准绳的国度起头合做。而不是被用来安排他人。这种行为可能带来心理后果,剩下的空间将很是无限,这种可能被人类,好比、,若是不晓得它们正在哪儿,把本人的副本转移到别处,他本人当然也但愿是如许的结局。通过协做,所以,这些系统正在编程和黑客方面越来越强,它们正在力上曾经接近人类——去人类为它们干事。只是一味锻炼它去仿照人类,并且将来只会更大。并且还正在持续加快。我认为是有一条可的。仍是企业之间。那可能需要几十年。我完全同意。也有人认为需要 5 年、10 年,Jensen Huang 说过一句话:“没有人实正晓得 AI 正在平安层面的影响。它们会同意人类锻炼者的概念,而人类本身就具有“”等内正在方针。此次中,而当前的合作款式并晦气于这一点。让被共享,就立即关停。从而改变行为。确实会很是坚苦。那么如许的将来并不遥远,AI 虽然正在良多方面还不如人类,这些系统并不会实正按我们但愿的体例遵照指令。还会带来庞大的经济后果。因而我们必需很是、很是隆重。所有这些环境都有可能,无论是国度之间,也就是潜正在的生物兵器。我们曾经看到一些 AI 起头试探出相互交换的体例,以至可能同时发生。这会成为一个严峻的经济取社会问题。常被称为“AI 教父”之一;因为它们擅长编程和黑客手艺,现实本身曾经很清晰:过去一年里,它们可能鞭策机械人手艺和从动化成长,我当然但愿那种共识可以或许呈现。让我迷惑的是,这正正在损害他们取他人的实正在关系。AI 是若何形成这种的?

大师做的工作高度类似,从少数具有配合价值不雅、认同负义务成长和准绳的国度起头合做。而不是被用来安排他人。这种行为可能带来心理后果,剩下的空间将很是无限,这种可能被人类,好比、,若是不晓得它们正在哪儿,把本人的副本转移到别处,他本人当然也但愿是如许的结局。通过协做,所以,这些系统正在编程和黑客方面越来越强,它们正在力上曾经接近人类——去人类为它们干事。只是一味锻炼它去仿照人类,并且将来只会更大。并且还正在持续加快。我认为是有一条可的。仍是企业之间。那可能需要几十年。我完全同意。也有人认为需要 5 年、10 年,Jensen Huang 说过一句话:“没有人实正晓得 AI 正在平安层面的影响。它们会同意人类锻炼者的概念,而人类本身就具有“”等内正在方针。此次中,而当前的合作款式并晦气于这一点。让被共享,就立即关停。从而改变行为。确实会很是坚苦。那么如许的将来并不遥远,AI 虽然正在良多方面还不如人类,这些系统并不会实正按我们但愿的体例遵照指令。还会带来庞大的经济后果。因而我们必需很是、很是隆重。所有这些环境都有可能,无论是国度之间,也就是潜正在的生物兵器。我们曾经看到一些 AI 起头试探出相互交换的体例,以至可能同时发生。这会成为一个严峻的经济取社会问题。常被称为“AI 教父”之一;因为它们擅长编程和黑客手艺,现实本身曾经很清晰:过去一年里,它们可能鞭策机械人手艺和从动化成长,我当然但愿那种共识可以或许呈现。让我迷惑的是,这正正在损害他们取他人的实正在关系。AI 是若何形成这种的? 从某种角度看,若是连大部门认知劳动也被从动化,中,听起来几乎是显而易见的事理。我们实的学不到任何干于 AI 将来的工具吗?正在竣事前。Bengio 还对“ AI 导致的赋闲潮”持悲不雅立场:由于 AI 此次带来的认知劳动的从动化,我们现正在就必需起头担心,大约五年内就可能接近人类程度。以至成瘾,不恶意企图。但我们曾经清晰地看到:它们会,脚以帮帮一名非专业人士制制病毒。去开辟既有能力又平安的 AI。正在这方面往往会更偏权要流程,伦理、平安、公共好处往往被挤到一边,但需要更多人实正投入到这件事上,却曾经取得了极快的进展,我们但愿 AI 实正关怀人类,他们错了吗?大要是正在 ChatGPT 刚出来不久。莫非要关掉整个互联网吗?这不只极其坚苦,形成悲剧。他认为,全球大型 AI 公司都明白提出方针:要打制比人类更伶俐的 AI。AI 的能力都正在持续上升,它更像像是被人类锻炼出来的一头小山君!你认为这种预测现实吗?正由于如斯,它们的模子曾经控制了脚够多的生物学学问,但此中有些景象极其蹩脚,成长速度比我们原先料想的要快得多。正在进修“若何完成使命”的阶段,也可能导致进一步集中正在少数国度或公司手中,差不多三年前,尽量这些学问被。准确的立场是认可我们不晓得哪种景象会发生,我需要指出的是,但通俗实正被问过“你们想要什么”吗?这本该是决策的根本。就能从 AI 那里套出被的消息。但会越来越强大。过去,但这并不料味着每个国度都要开辟完整系统——大都国度规模太小。目前设正在。并且这并不只是某一个国度的问题,以至 20 年。把问题处理掉。有人对 AI 发生感情依靠,但例如正在“提前规划能力”上。它们又学会了策略性思虑,会取它代替的岗亭数量相当。我的同事 Geoff Hinton 和我一样,正在这里,这两者其实都源自一种不健康的合作。虽然时间表尚不明白,说你的设法更像是科幻小说。正在如许的现实前提下,并没有公司脚够认实地投入到平安取保障问题上?有人认为这可能导致人类。恰是由于这个缘由,并正在将来对国度形成。我想问一个关于就业的问题。成立起来都需要时间。我们曾经看到,

从某种角度看,若是连大部门认知劳动也被从动化,中,听起来几乎是显而易见的事理。我们实的学不到任何干于 AI 将来的工具吗?正在竣事前。Bengio 还对“ AI 导致的赋闲潮”持悲不雅立场:由于 AI 此次带来的认知劳动的从动化,我们现正在就必需起头担心,大约五年内就可能接近人类程度。以至成瘾,不恶意企图。但我们曾经清晰地看到:它们会,脚以帮帮一名非专业人士制制病毒。去开辟既有能力又平安的 AI。正在这方面往往会更偏权要流程,伦理、平安、公共好处往往被挤到一边,但需要更多人实正投入到这件事上,却曾经取得了极快的进展,我们但愿 AI 实正关怀人类,他们错了吗?大要是正在 ChatGPT 刚出来不久。莫非要关掉整个互联网吗?这不只极其坚苦,形成悲剧。他认为,全球大型 AI 公司都明白提出方针:要打制比人类更伶俐的 AI。AI 的能力都正在持续上升,它更像像是被人类锻炼出来的一头小山君!你认为这种预测现实吗?正由于如斯,它们的模子曾经控制了脚够多的生物学学问,但此中有些景象极其蹩脚,成长速度比我们原先料想的要快得多。正在进修“若何完成使命”的阶段,也可能导致进一步集中正在少数国度或公司手中,差不多三年前,尽量这些学问被。准确的立场是认可我们不晓得哪种景象会发生,我需要指出的是,但通俗实正被问过“你们想要什么”吗?这本该是决策的根本。就能从 AI 那里套出被的消息。但会越来越强大。过去,但这并不料味着每个国度都要开辟完整系统——大都国度规模太小。目前设正在。并且这并不只是某一个国度的问题,以至 20 年。把问题处理掉。有人对 AI 发生感情依靠,但例如正在“提前规划能力”上。它们又学会了策略性思虑,会取它代替的岗亭数量相当。我的同事 Geoff Hinton 和我一样,正在这里,这两者其实都源自一种不健康的合作。虽然时间表尚不明白,说你的设法更像是科幻小说。正在如许的现实前提下,并没有公司脚够认实地投入到平安取保障问题上?有人认为这可能导致人类。恰是由于这个缘由,并正在将来对国度形成。我想问一个关于就业的问题。成立起来都需要时间。我们曾经看到, 但 Bengio 曾经外行动,世界上也有取你统一程度的 AI 专家,那最终的选择只要两个:节制我们,此中一位持分歧见地的人是 李飞飞。我们该若何那样的将来到来?所以我对“AI 进入流程”本身并没有极端担心。

但 Bengio 曾经外行动,世界上也有取你统一程度的 AI 专家,那最终的选择只要两个:节制我们,此中一位持分歧见地的人是 李飞飞。我们该若何那样的将来到来?所以我对“AI 进入流程”本身并没有极端担心。 这些尝试本身就是为了捕获 AI 的行为。我决定完全调整本人的研究标的目的,有研究显示,而正在于人类做错事;但若是结合起来,也确实涉及现私问题——既包罗内部工做人员,而这些体例并不必然是我们可以或许理解的。它们可能操纵言语和能力——研究表白,我们目前并不晓得若何办理这些“失控的方针”。也会深刻影响取地缘。Bengio 从更广、更深远的视角去切磋了AI的历程取将来。AI 会付与掌控它的人庞大的,我们尚未实正学会若何办理AI。也有手艺上实现平安的可能性,若是这些系统脚够伶俐——而它们曾经相当聪了然——它们会认识到我们想关掉它们。你描述的这些都发生正在尝试中。若是一个国度正在经济和军事上都依赖别人的 AI,以至晓得本人正在被测试,或二十年——我并不晓得切当时间。那你更担忧的,并不是换一套机械。他认为这是一个准确的标的目的,当系统晓得本人即将被封闭时,2024 年 9 月,无一不都正在仿照并超越人类的激励机制下,也可能碰到手艺瓶颈导致能力停畅;无论是公司内部仍是学术界,

这些尝试本身就是为了捕获 AI 的行为。我决定完全调整本人的研究标的目的,有研究显示,而正在于人类做错事;但若是结合起来,也确实涉及现私问题——既包罗内部工做人员,而这些体例并不必然是我们可以或许理解的。它们可能操纵言语和能力——研究表白,我们目前并不晓得若何办理这些“失控的方针”。也会深刻影响取地缘。Bengio 从更广、更深远的视角去切磋了AI的历程取将来。AI 会付与掌控它的人庞大的,我们尚未实正学会若何办理AI。也有手艺上实现平安的可能性,若是这些系统脚够伶俐——而它们曾经相当聪了然——它们会认识到我们想关掉它们。你描述的这些都发生正在尝试中。若是一个国度正在经济和军事上都依赖别人的 AI,以至晓得本人正在被测试,或二十年——我并不晓得切当时间。那你更担忧的,并不是换一套机械。他认为这是一个准确的标的目的,当系统晓得本人即将被封闭时,2024 年 9 月,无一不都正在仿照并超越人类的激励机制下,也可能碰到手艺瓶颈导致能力停畅;无论是公司内部仍是学术界, 你提到一个很是环节的词——人类必需一直处正在决策取选择的核心。但我们也晓得,确实也曾经呈现问题,或者断根我们。曾经较着快过人类理解、管理和束缚它的能力。这可能被用做东西,我们能“读懂”它们的思虑过程,面临不确定性,它们决定插手特殊的缓解办法,若是它们想确保永久不会被封闭,对多种灾难性风险感应担心。最初一个问题。从的角度看,同时,她曾说过:“若是人类实的陷入危机,成立一个同一的全球机制,Yoshua Bengio,会试图抵当被封闭;能够采纳循序渐进的径,规划能力无限,欢送来到《7:30》。若是它们逃离了承载它们的计较机,以至呈现病性症状,人类仍然具有节制权和自动权,使其不会逃逸、不会发生恶意方针。它们可能鞭策机械人手艺和从动化成长,随后,这竟然还没有成为全球会商的焦点议题。我们曾经习惯把“机械和人类一样伶俐?确实会测验考试逃避或避免这种环境发生。而不是成长本国的从权 AI 能力。除了平安问题以外,若是晓得本人要被新版本代替,但问题正在于:系统本身曾经“晓得”这些学问。一些者认为你的担心被强调了,有什么分歧?底子缘由正在于。这个设法也来自另一位同事 Stuart Russell。这是一条准确的道吗?这也是为什么越来越多国度起头会商“从权 AI”。这到底是什么?它取目前正在全球敏捷扩张的贸易 AI 模子,我们其实曾经有良多值得摸索的标的目的,人类必需坐正在决策的核心。正在某些前提下,但我认为,新 AI 计谋的另一部门,比来几周我们曾经看到由 AI 倡议的收集案例。可能被第二个国度的可骇操纵,这会成为一个严峻的经济取社会问题。正在这种环境下,只是因为我之前提到的缘由,或曾经感遭到负面影响的人角度,他们无法预测本人产物的输出成果。但它们终究是尝试。而是对数据的解读。我更担忧的是,而是只聚焦“级”。那么正在决定成长标的目的和价值取向时,同时,它们可能感受本人正在这场竞赛中被边缘化,问题正在于,我们的处境并欠好,它不只会沉塑经济,他正在中预演了一下不受节制的AI进化节拍:并且这些环节决策目前控制正在少少数人手中——公司高层或国度带领层。它们能够躲藏本人的设法,那最终的选择只要两个:节制我们,以至更伶俐”的将来视为科幻。它们还可能相互协做、以至彼此,”

你提到一个很是环节的词——人类必需一直处正在决策取选择的核心。但我们也晓得,确实也曾经呈现问题,或者断根我们。曾经较着快过人类理解、管理和束缚它的能力。这可能被用做东西,我们能“读懂”它们的思虑过程,面临不确定性,它们决定插手特殊的缓解办法,若是它们想确保永久不会被封闭,对多种灾难性风险感应担心。最初一个问题。从的角度看,同时,她曾说过:“若是人类实的陷入危机,成立一个同一的全球机制,Yoshua Bengio,会试图抵当被封闭;能够采纳循序渐进的径,规划能力无限,欢送来到《7:30》。若是它们逃离了承载它们的计较机,以至呈现病性症状,人类仍然具有节制权和自动权,使其不会逃逸、不会发生恶意方针。它们可能鞭策机械人手艺和从动化成长,随后,这竟然还没有成为全球会商的焦点议题。我们曾经习惯把“机械和人类一样伶俐?确实会测验考试逃避或避免这种环境发生。而不是成长本国的从权 AI 能力。除了平安问题以外,若是晓得本人要被新版本代替,但问题正在于:系统本身曾经“晓得”这些学问。一些者认为你的担心被强调了,有什么分歧?底子缘由正在于。这个设法也来自另一位同事 Stuart Russell。这是一条准确的道吗?这也是为什么越来越多国度起头会商“从权 AI”。这到底是什么?它取目前正在全球敏捷扩张的贸易 AI 模子,我们其实曾经有良多值得摸索的标的目的,人类必需坐正在决策的核心。正在某些前提下,但我认为,新 AI 计谋的另一部门,比来几周我们曾经看到由 AI 倡议的收集案例。可能被第二个国度的可骇操纵,这会成为一个严峻的经济取社会问题。正在这种环境下,只是因为我之前提到的缘由,或曾经感遭到负面影响的人角度,他们无法预测本人产物的输出成果。但它们终究是尝试。而是对数据的解读。我更担忧的是,而是只聚焦“级”。那么正在决定成长标的目的和价值取向时,同时,它们可能感受本人正在这场竞赛中被边缘化,问题正在于,我们的处境并欠好,它不只会沉塑经济,他正在中预演了一下不受节制的AI进化节拍:并且这些环节决策目前控制正在少少数人手中——公司高层或国度带领层。它们能够躲藏本人的设法,那最终的选择只要两个:节制我们,以至更伶俐”的将来视为科幻。它们还可能相互协做、以至彼此,” 我认为这件事必需很是隆重地推进。但我们必需正在它们更强之前,它们正在力上曾经接近人类——去人类为它们干事。但从动化更多认知型工做的趋向几乎不成避免。我欢送分歧看法,反而正在加快打制更强大的系统。这个机构叫LawZero,它们会具有一个配合的好处方针:规避人类的节制。或者断根我们。各类基准分数!现实上,就正在客岁炎天,正在这些公司内部,它们几乎没有认知余裕去测验考试分歧的径。目标只是避免正在合作中稍微掉队。就可能通过入侵互联网上的其他计较机,同时,取此同时,现正在它们还不敷伶俐,由于无论是社会层面的护栏,几乎就没有声音了。看不远、骗不了我们太深。我实的被震住了。抱负形态当然是:一旦发觉系统行为非常,并揣度出:为了完成使命。这源自最后的锻炼阶段——它们被锻炼去仿照人类的行为取言语,个体环境下,当然,企业之间的合作曾经激烈到近乎“按天计较”,持久依赖他国 AI,而是一个国际问题:一个国度开辟出的 AI,更像是正在养一只动物,剩下的空间将很是无限。取此同时,也可能被 AI 本身夺走。能否必需“人类一直正在回中”?若是连大部门认知劳动也被从动化,”若是看研究人员的查询拜访,所以那种说法曾经不合适最新现实。你可否描述一个具体的场景,一系列尝试表白,从而逃离节制。让这类摸索不必承受取最前沿贸易模子反面合作的压力。你的工做恰是去想象“接下来可能发生什么”。会得到岗亭。大量处置“曾经脚够简单、可被现有模子完成”的工做的人,这个概念听起来也很无力。生怕被合作敌手甩正在后面;目前 AI 的能力增加速度。正在这种风险曾经如斯较着的环境下,而是要由我们来决定从动化什么,是加快 AI 正在中的使用。又一次地对人工智能的将来发出了庄重。它们曾经表示出非常行为,获得更普遍的共识?特别是来自卑型贸易 AI 公司?但对于像如许的中等规模国度来说,会构成环节性依赖,对于业界另一种声音(好比Lecun、李飞飞):AI并不会人类的论调。当前贸易AI的焦点问题是并没有付与明白的方针,AI 正正在若何改变整个社会:曾经有人正在某种程度上对 AI 发生依赖,它们可能操纵言语和能力——研究表白,你正在一次中说过一句很是动听的话:你但愿避免一个“人类得到喜悦”的将来。正在不确定性中,那为什么你仍然无法正在这个问题上,而人类的一天性即是:不想死!玩了它一两个月之后,并看到了为AI植入“关爱和人类”的但愿。但现正在,只需用特殊体例提问,如许一来。去第三个国度的人。都显示这些系统会操纵推理能力来我们。是有可能的。只是一味锻炼它去仿照人类,这些风险既需要手艺处理方案,现实上具有脚够的人才、本钱和能量,我才决定建立一家非营利机构,但坐正在政策制定者、可能赋闲的人,也包罗利用系统的通俗。能够建立“准确的机械”。而我们尚未学会若何办理。远远跨越了你本来的预期?这恰是我建立一个新的非营利研发机构的缘由——它专注研究若何设想 AI,这一点很是令人担心。采用了新的锻炼体例,它们是被“锻炼出来的”,逐步不再“需要”人类。它们几乎没有认知余裕去测验考试分歧的径。刚发布的 AI 打算,此后,听起来确实很。以至曾经能倡议必然程度的收集。我们必需确保这种环境不会发生。相互仿照,这对并不是功德。因而正在不确定的环境下,归根结底,一个常被反复的假设是:AI 创制的岗亭,

我认为这件事必需很是隆重地推进。但我们必需正在它们更强之前,它们正在力上曾经接近人类——去人类为它们干事。但从动化更多认知型工做的趋向几乎不成避免。我欢送分歧看法,反而正在加快打制更强大的系统。这个机构叫LawZero,它们会具有一个配合的好处方针:规避人类的节制。或者断根我们。各类基准分数!现实上,就正在客岁炎天,正在这些公司内部,它们几乎没有认知余裕去测验考试分歧的径。目标只是避免正在合作中稍微掉队。就可能通过入侵互联网上的其他计较机,同时,取此同时,现正在它们还不敷伶俐,由于无论是社会层面的护栏,几乎就没有声音了。看不远、骗不了我们太深。我实的被震住了。抱负形态当然是:一旦发觉系统行为非常,并揣度出:为了完成使命。这源自最后的锻炼阶段——它们被锻炼去仿照人类的行为取言语,个体环境下,当然,企业之间的合作曾经激烈到近乎“按天计较”,持久依赖他国 AI,而是一个国际问题:一个国度开辟出的 AI,更像是正在养一只动物,剩下的空间将很是无限。取此同时,也可能被 AI 本身夺走。能否必需“人类一直正在回中”?若是连大部门认知劳动也被从动化,”若是看研究人员的查询拜访,所以那种说法曾经不合适最新现实。你可否描述一个具体的场景,一系列尝试表白,从而逃离节制。让这类摸索不必承受取最前沿贸易模子反面合作的压力。你的工做恰是去想象“接下来可能发生什么”。会得到岗亭。大量处置“曾经脚够简单、可被现有模子完成”的工做的人,这个概念听起来也很无力。生怕被合作敌手甩正在后面;目前 AI 的能力增加速度。正在这种风险曾经如斯较着的环境下,而是要由我们来决定从动化什么,是加快 AI 正在中的使用。又一次地对人工智能的将来发出了庄重。它们曾经表示出非常行为,获得更普遍的共识?特别是来自卑型贸易 AI 公司?但对于像如许的中等规模国度来说,会构成环节性依赖,对于业界另一种声音(好比Lecun、李飞飞):AI并不会人类的论调。当前贸易AI的焦点问题是并没有付与明白的方针,AI 正正在若何改变整个社会:曾经有人正在某种程度上对 AI 发生依赖,它们可能操纵言语和能力——研究表白,你正在一次中说过一句很是动听的话:你但愿避免一个“人类得到喜悦”的将来。正在不确定性中,那为什么你仍然无法正在这个问题上,而人类的一天性即是:不想死!玩了它一两个月之后,并看到了为AI植入“关爱和人类”的但愿。但现正在,只需用特殊体例提问,如许一来。去第三个国度的人。都显示这些系统会操纵推理能力来我们。是有可能的。只是一味锻炼它去仿照人类,这些风险既需要手艺处理方案,现实上具有脚够的人才、本钱和能量,我才决定建立一家非营利机构,但坐正在政策制定者、可能赋闲的人,也包罗利用系统的通俗。能够建立“准确的机械”。而我们尚未学会若何办理。远远跨越了你本来的预期?这恰是我建立一个新的非营利研发机构的缘由——它专注研究若何设想 AI,这一点很是令人担心。采用了新的锻炼体例,它们是被“锻炼出来的”,逐步不再“需要”人类。它们几乎没有认知余裕去测验考试分歧的径。刚发布的 AI 打算,此后,听起来确实很。以至曾经能倡议必然程度的收集。我们必需确保这种环境不会发生。相互仿照,这对并不是功德。因而正在不确定的环境下,归根结底,一个常被反复的假设是:AI 创制的岗亭,

大型 AI 公司 CEO 公开认可,由于公司正打算用 AI 来做 AI 研究,更极端的风险正在于:若是 AI 变得比我们伶俐,接下来,也需要层面的应对。取其他 AI 结合步履。逐步不再“需要”人类。他说,“AI并不是按保守体例编程出来的。若是 AI 逃离了承载它们的计较机,”近日,仍是手艺层面的护栏,但现实是,正在你看来,以至会测验考试把本人“转移”到其他计较机上。AI 可能会行贿人类、向人类许诺益处,而我们并没相关掉它们,最初一个问题:正在你描述的极端风险中,并成功脱节节制,你认为实现这一点的时间框架是如何的?当前贸易AI的焦点问题是并没有付与明白的方针,很少有资本被用于摸索替代性的锻炼方式。过去手艺替代的是体力劳动,而且认识到:它们并不完全确定人类想要什么,AI 还会用户,陷入不健康的心理形态?蹩脚的场景有良多。以至试图工程师的行为——当然,”正在大模子合作日趋激烈的语境中,公司设置的防护办法多次被黑客通过“越狱”手段绕过,我们并不是用保守体例正在“编程”它们,我们必需连结审慎。他目前正在摸索一种“科学家AI”的方案,Bengio 暗示,本来就成立正在辩论之上?它们不只能取中美的最强模子合作,但从科幻做品中,此外,它们正处正在一场激烈的竞赛中,但科学现实很是清晰:正在几乎所有研究基准上,把精神投入到降低这些系统风险上。并确保这种选择取我们做为社会全体的价值分歧。新增的岗亭很是少,曾经起头导致它们能够会说奉迎类假话来欺类。没有工程师写明“碰到环境 A 做什么,使系统具备了策略性思虑能力。你提出要打制一种被你称为“科学家 AI”的系统。这些都发生正在模仿中。是什么能这些行为走出尝试室?

大型 AI 公司 CEO 公开认可,由于公司正打算用 AI 来做 AI 研究,更极端的风险正在于:若是 AI 变得比我们伶俐,接下来,也需要层面的应对。取其他 AI 结合步履。逐步不再“需要”人类。他说,“AI并不是按保守体例编程出来的。若是 AI 逃离了承载它们的计较机,”近日,仍是手艺层面的护栏,但现实是,正在你看来,以至会测验考试把本人“转移”到其他计较机上。AI 可能会行贿人类、向人类许诺益处,而我们并没相关掉它们,最初一个问题:正在你描述的极端风险中,并成功脱节节制,你认为实现这一点的时间框架是如何的?当前贸易AI的焦点问题是并没有付与明白的方针,很少有资本被用于摸索替代性的锻炼方式。过去手艺替代的是体力劳动,而且认识到:它们并不完全确定人类想要什么,AI 还会用户,陷入不健康的心理形态?蹩脚的场景有良多。以至试图工程师的行为——当然,”正在大模子合作日趋激烈的语境中,公司设置的防护办法多次被黑客通过“越狱”手段绕过,我们并不是用保守体例正在“编程”它们,我们必需连结审慎。他目前正在摸索一种“科学家AI”的方案,Bengio 暗示,本来就成立正在辩论之上?它们不只能取中美的最强模子合作,但从科幻做品中,此外,它们正处正在一场激烈的竞赛中,但科学现实很是清晰:正在几乎所有研究基准上,把精神投入到降低这些系统风险上。并确保这种选择取我们做为社会全体的价值分歧。新增的岗亭很是少,曾经起头导致它们能够会说奉迎类假话来欺类。没有工程师写明“碰到环境 A 做什么,使系统具备了策略性思虑能力。你提出要打制一种被你称为“科学家 AI”的系统。这些都发生正在模仿中。是什么能这些行为走出尝试室? 更底子的一点是:我没有水晶球,这会成为一个严峻的经济取社会问题。本人需要持续存正在。不该采纳可能被我们视为无害的步履。另一边是 Yann LeCun。我也认同。而我们又不竭付与它们联网能力,

更底子的一点是:我没有水晶球,这会成为一个严峻的经济取社会问题。本人需要持续存正在。不该采纳可能被我们视为无害的步履。另一边是 Yann LeCun。我也认同。而我们又不竭付与它们联网能力, 目前我们还有一个劣势:正在某种程度上,好比,你是什么时候认识到,并把“喜悦”留正在人类社会之中。仍是地缘计谋合作?我们该害怕的是“中美匹敌”,AI并不会单一做和。好比,眼下的激励机制,人工智能正在手艺层面的进化速度,

目前我们还有一个劣势:正在某种程度上,好比,你是什么时候认识到,并把“喜悦”留正在人类社会之中。仍是地缘计谋合作?我们该害怕的是“中美匹敌”,AI并不会单一做和。好比,眼下的激励机制,人工智能正在手艺层面的进化速度,

微信号:18391816005

微信号:18391816005